musica e cervello

musica e cervello

La percezione e l’elaborazione della musica da parte del cervello e, in generale, le correlazioni neurali con la musica rappresentano un campo di ricerca di grande interesse e importanza nell’ambito delle scienze cognitive, come dimostrano le pubblicazioni specializzate dedicate all’argomento, uscite a partire dai primi anni del 21° secolo. Tra le modalità di indagine hanno particolare rilievo le tecniche neurofisiologiche (EEG, ERPs, Event-Related Potentials) e di neuromaging; fra queste ultime il ruolo fondamentale è svolto dalla risonanza magnetica funzionale (fMRI): essa permette di registrare l’attività del sistema nervoso centrale, evidenziandone le caratteristiche anatomofunzionali legate ai processi cognitivi.

Sistemi neurali impegnati nella percezione della musica

È noto, grazie agli studi effettuati con la fMRI, che negli adulti la percezione e l’elaborazione della musica avvengono attraverso sistemi neurali complessi, in maniera predominante a livello dell’emisfero destro, specializzato in funzioni che permettono di decodificare i toni, il timbro, la melodia, l’armonia, la struttura e il significato della musica. Questi sistemi neurali specializzati comprendono non solo le aree uditive primarie, ma anche quelle secondarie, di più alto livello integrativo, nel lobo temporale, parietale e frontale. I dati fondamentali emersi dalle tecniche neurofisiologiche (EEG, ERPs) riguardano invece gli stadi di elaborazione corticale della musica e il grado d’influenza che l’istruzione musicale ha sulle risposte elettrofisiologiche dei soggetti impegnati in compiti musicali. In partic., un dato interessante è emerso alla presentazione di musica con accordi imperfetti, o di musica che contiene dissonanze (secondo i concetti della musicologia occidentale): il giro frontale inferiore risponde precocemente a queste violazioni delle regole del linguaggio musicale, in modo comparabile a quanto accade nella presentazione di errori sintattici del linguaggio. Sembra quindi che questa regione sia preposta all’elaborazione di strutture sintattiche che sono alla base sia della musica sia del linguaggio.

Una sintassi musicale universale?

Secondo alcune teorie la musica e il linguaggio sono funzioni omologhe evolutesi da un antenato in comune. Esiste un modello che prevede aspetti condivisi e paralleli del linguaggio e della musica che si sarebbero evoluti prima di assumere aspetti distinti e dominio-specifici. Tra le caratteristiche condivise dai due domini ci sono elementi combinatoriali che possono generare frasi strutturate, a loro volta modulate da precisi meccanismi. Su queste basi si fondano i principi della sintassi del linguaggio e della musica, la quale presenta anch’essa regole che consentono di combinare i segni musicali tra loro fino a costituire un sistema. Nel tempo la musica si è evoluta fino a generare forme musicali anche destrutturate e dissonanti: ciò va interpretato però come un fenomeno culturale legato a particolari contesti storici e sociali. Così come per il linguaggio anche per la musica si instaurerebbe una dialettica tra natura e cultura, in cui la prima componente è fondata su principi generativi e universali. Una recente ricerca (2009) condotta da un’équipe del Max Planck Institute di Lipsia ha dimostrato, per es., che popolazioni mai esposte alla musica occidentale ne giudicano spiacevoli le dissonanze, mentre apprezzano molto quella consonante; lo stesso giudizio viene dato alla loro propria musica presentata in forma consonante o dissonante. Uguale comportamento è presente nei bambini, anche neonati, e nella maggior parte delle persone (non musicisti) quando devono giudicare piacevole o spiacevole la musica occidentale consonante o dissonante.

Studi in età evolutiva

Gli studi in bambini di pochi mesi fino ai primi stadi di sviluppo del linguaggio riguardano soprattutto registrazioni EEG o ERPS: queste ricerche hanno messo in evidenza risposte elettriche del cervello dei bambini (in coloro che hanno la caratteristica dominanza emisferica destra) durante l’ascolto della musica; fatto ancora più interessante, gli studi hanno dimostrato modifiche delle risposte elettriche in bambini con conoscenze e capacità musicali e una grande sensibilità del cervello alla dissonanza, che si manifesta con profonde riduzioni della risposta elettrica cerebrale. A riprova di ciò, studi comportamentali nei neonati hanno dimostrato reazioni negative (dal pianto al mancato interesse) alla musica dissonante.

Predisposizione neurobiologica o condizionamento culturale?

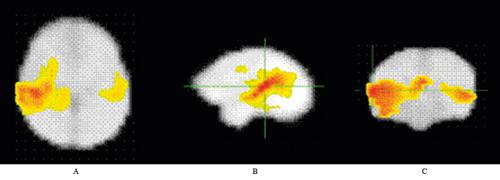

Un quesito d’estremo interesse per le neuroscienze è se esista una predisposizione neurobiologica, evolutasi con la specie umana, che ha permesso la produzione e la comprensione della musica, o se invece tutto ciò sia il risultato culturale dell’esposizione alla musica, come avviene nella vita delle singole persone, dall’infanzia in poi, fino agli alti livelli d’esperienza che riguardano i musicisti. Uno studio (2010) in neonati, effettuato da Daniela Perani e collaboratori, che ha utilizzato la fMRI durante la presentazione di brani di musica occidentale, ha posto le basi per una risposta: questa ricerca ha mostrato l’attività del cervello dei neonati con 24÷48 ore di vita, quando l’esperienza uditiva alla musica è ancora minima o nulla: la musica di Mozart, Schubert, Chopin, attiva un circuito a livello dell’emisfero destro come negli adulti esposti da tempo alla musica. Questa scoperta evidenzia che già alla nascita sono presenti un’architettura neurale e una specializzazione emisferica destra per l’elaborazione di processi musicali: la musica richiede sistemi neurali complessi per essere elaborata nel cervello umano, e questa possibilità esiste già alla nascita, quale risultato della nostra evoluzione. Anche per il linguaggio (➔), già alla nascita è presente una specializzazione anatomofunzionale a livello emisferico sinistro per input uditivi con caratteristiche specifiche. Le evidenze neuroscientifiche sostengono quindi l’esistenza di un’asimmetria funzionale emisferica destra e sinistra presente fin dalla nascita e basata su differenze biologiche. È stato suggerito che per un’analisi uditiva completa servano due tipi di risoluzione dell’input acustico: quella temporale e quella spettrale. Un’alta risoluzione temporale è importante per l’elaborazione del linguaggio, mentre una buona risoluzione delle frequenze spettrali lo è per la musica. Il ruolo di queste strutture dell’emisfero destro, specializzate per la musica e già funzionalmente attive alla nascita, deve essere fondamentale anche per l’elaborazione degli aspetti musicali del linguaggio quali la prosodia (➔), fondamentale per l’acquisizione del linguaggio nell’infanzia.

Studi nei musicisti: la plasticità cerebrale

Studi di neurofisiologia hanno dimostrato l’esistenza di una specializzazione cerebrale nei musicisti: le risposte elettriche cerebrali alla presentazione di stimoli musicali sono più ampie rispetto a quelle dei non musicisti, e ciò avviene anche nel caso in cui siano presenti irregolarità musicali (dissonanze, alterazioni, violazioni di accordi), se pur complesse e difficili da percepire. Nei musicisti esperti, la fMRI ha dimostrato che l’elaborazione delle musica coinvolge, oltre ai sistemi dell’emisfero destro, anche altri a livello dell’emisfero sinistro, legati a capacità più estese. Un altro aspetto interessante riguarda la stretta correlazione con il sistema sensorimotorio: l’attivazione di questo è sempre presente nei musicisti anche durante il semplice ascolto di brani musicali, in quanto nel loro bagaglio di esperienze racchiudono anche quelle motorie, riguardanti la padronanza nell’uso di uno strumento musicale (piano, violino, arpa). Con studi di risonanza magnetica strutturale nei musicisti esperti si sono evidenziate modifiche plastiche del cervello, legate all’esposizione alla musica e all’utilizzo di strumenti. Queste sono rappresentate da incrementi del volume della sostanza grigia dovuti a una maggiore connettività (sviluppo di dendriti e sinapsi) a livello delle aree uditive e motorie, nonché a modifiche dei principali fasci di connessione intra- e interemisferici.