Sistemi disordinati

Sistemi disordinati

I sistemi disordinati possono trovarsi ovunque e apparire con svariate forme e componenti in discipline molto differenti, fra cui la fisica dello stato solido, la neurobiologia, le scienze computazionali, le teorie evolutive, l'economia e le scienze sociali. Si tratta, nella terminologia corrente, di sistemi a molti corpi composti da un gran numero di parti microscopiche interagenti tra loro in maniera non uniforme, che rivestono interesse per il loro comportamento cooperativo. La forma dettagliata di queste interazioni spesso dipende da variabili casuali, ed è per questo che tali sistemi sono detti disordinati. Nell'ultimo quarto del XX sec. ci si è resi conto che sistemi di questo tipo possono presentare un comportamento collettivo emergente estremamente ricco e complesso, che soltanto in alcuni casi è stato compreso fino in fondo e il cui studio è uno dei campi più interessanti della ricerca attuale, con molti risvolti interdisciplinari. I primi studi sistematici sono stati compiuti nell'ambito della fisica e, successivamente, sono nate le applicazioni in campi differenti: per questo motivo discuteremo innanzi tutto il caso della materia condensata.

In fisica, il disordine compare spesso, ma con caratteristiche molto diverse a seconda dei casi. Per esempio, sono disordinati sia i gas sia i liquidi. Nei gas, completamente disordinati, le molecole si muovono rapidamente senza avere una posizione fissa. Nei liquidi, la densità è più alta e le posizioni di atomi vicini sono correlate; tuttavia, fra atomi lontani non esiste correlazione. Nei solidi cristallini, gli atomi sono ordinati periodicamente nello spazio su distanze macroscopiche, grandi rispetto alla separazione interatomica media, e ognuno rimane congelato nella posizione che aveva al momento della formazione del cristallo a parte piccole oscillazioni diorigine termica, di modesta ampiezza rispetto alla scala interatomica, e deboli fenomeni di diffusione irrilevanti in questo contesto. La transizione di fase da uno stato mobile a uno congelato è un passaggio dal disordine all'ordine, da uno stato di simmetria minore a uno di simmetria maggiore. Tale definizione di disordine non è però quella solitamente adottata quando si parla di sistemi disordinati, benché molto dell'interesse verso questi ultimi coinvolga concetti di transizione di fase da stati in rapido movimento a stati a tutti gli effetti congelati. Nel contesto che ci interessa, l'espressione è usata con riferimento a sistemi in cui alcune proprietà delle parti microscopiche costituenti sono sia congelate (o molto lentamente variabili) sia non periodiche spazialmente (come in un cristallo). Esempi di solidi disordinati sono le leghe metalliche, in cui i siti del reticolo cristallino sono occupati a caso da atomi di diverso tipo, e i vetri, in cui le posizioni atomiche sono in pratica congelate ma prive di periodicità; è possibile comunque che altre proprietà degli elementi costitutivi, per esempio quelle associate con il moto elettronico o con l'orientazione degli spin, evolvano velocemente.

Alcuni sistemi disordinati 'semplici'

Gli aspetti dei sistemi disordinati di maggior rilievo per il loro interesse scientifico e le possibili applicazioni riguardano gli effetti del disordine cosiddetto congelato (quenched), dovuto a componenti del sistema che non possono muoversi, sulla mobilità delle altre componenti microscopiche. In ogni caso, prima di affrontare questa problematica è opportuno descrivere alcuni esempi di comportamento dovuti al disordine congelato, in cui tali effetti sulla mobilità non risultano importanti. Un primo esempio è l'origine del colore di molte gemme, dovuto alla presenza di impurezze isolate nel cristallo: queste agiscono in pratica come singoli atomi, dotati di uno spettro discreto di livelli energetici, che risuonano a frequenze ottiche discrete; le impurezze assorbono tali frequenze dalla luce bianca incidente e appaiono colorate. Un secondo esempio è quello relativo alla resistenza elettrica nei normali metalli, che persiste anche alle temperature più basse, a causa della diffusione degli elettroni dovuta alle impurezze (laddove nei superconduttori la resistenza crolla a zero al di sotto di una certa temperatura critica). Un ulteriore caso è connesso con la variazione della densità degli elettroni capaci di trasportare la corrente, che si realizza in un solido cambiando la proporzione dei costituenti atomici. Questa variazione può modificare profondamente il comportamento del sistema, con conseguenze molto rilevanti: per esempio, in diversi chip a semiconduttore, un attento drogaggio permette di ottenere effetti che costituiscono il cuore di molti strumenti elettronici, come il raddrizzamento e l'amplificazione. In altri casi, il cambiamento nella densità degli elettroni di conduzione è all'origine di effetti collettivi, che possono anche dare luogo a una transizione di fase in cui cambiano le proprietà qualitative del sistema, tanto che un magnete si può smagnetizzare o un metallo normale (o addirittura un isolante) può trasformarsi in un superconduttore.

Un altro concetto facilmente visualizzabile, che coinvolge il disordine, è quello della percolazione. Consideriamo un insieme di elementi, conduttori o isolanti, scelti a caso, connessi tra loro a formare un reticolo (per es., un recipiente pieno di palline, alcune di vetro, altre di metallo). Ci sarà conduzione da una parte all'altra soltanto se si realizza un circuito, vale a dire se esiste un cammino continuo di elementi conduttori tra le due parti. Questo compotamento è detto percolazione. Si possono altresì avere esclusivamente elementi conduttori, ma con connessioni variabili che in alcuni casi consentano il passaggio di corrente e in altri no (per es., un mucchio di aghi gettati su un tavolo). La conduttività dipenderà dal numero e dalla resistenza dei cammini conduttori. Situazioni analoghe abbondano in molti contesti: per esempio, nei solidi potenzialmente magnetici, i nodi del circuito potrebbero rappresentare atomi, alcuni dei quali con momento magnetico e gli elementi conduttori interazioni che cercano di orientare i momenti magnetici parallelamente l'uno rispetto all'altro; in questo caso, l'analogo della percolazione è l'apparire di un ordine magnetico macroscopico spontaneo (ordine nel senso specificato sopra).

Uno dei motivi fondamentali dell'interesse che i fisici hanno per tali sistemi sta nel fatto che la transizione dalla fase non percolante a quella percolante mostra un comportamento critico, caratterizzato dall'universalità degli esponenti che descrivono l'andamento verso la soglia di percolazione; proprietà macroscopiche seguono leggi di potenza in funzione della deviazione della densità del disordine dal suo valore critico, con esponenti che dipendono soltanto dalla classe generale, e non dai dettagli della struttura microscopica del sistema. Lo studio dei fenomeni critici e della loro universalità è stata una delle più grandi sfide intellettuali negli ultimi trent'anni del XX secolo. Un altro effetto del disordine congelato è il fenomeno della localizzazione elettronica. In assenza di disordine, le funzioni d'onda degli elettroni nei metalli si estendono all'intero solido, permettendo la conduzione elettronica una volta applicata una differenza di potenziale. Quando è presente disordine nei potenziali locali cui sono soggetti gli elettroni, alcune funzioni d'onda diventano localizzate nelle regioni dove il potenziale è più attrattivo per effetto di fluttuazioni statistiche. Se il potenziale indotto dal disordine è sufficientemente grande, la conduzione elettrica si annulla completamente al tendere della temperatura allo zero assoluto e provoca una transizione da metallo a isolante. A temperatura non nulla, le fluttuazioni termiche possono sempre avere luogo e indurre il passaggio di corrente elettrica, ma nella fase isolante ogni conduzione risultante è piccola e di tipo non metallico. Questo fenomeno è più intenso in sistemi unidimensionali o bidimensionali. In sistemi lineari (unidimensionali), qualsiasi disordine macroscopico è sufficiente a prevenire la conduzione metallica. Anche in questo caso vi sono interessanti fluttuazioni critiche ed effetti caratterizzati da esponenti universali vicini ai valori critici del disordine.

Sistemi complessi

Concentriamoci ora, in particolare, su una delle più grandi rivoluzioni concettuali dell'ultimo quarto del Novecento, che ha condotto a implicazioni sia pratiche sia teoriche assai ampie in molte aree della scienza ed è scaturita dall'aver considerato sistemi che combinano il disordine congelato con un'altra proprietà ‒ nota come frustrazione ‒ che si riferisce a situazioni nelle quali le propensioni di componenti, o gruppi di componenti, del sistema sono in conflitto le une con le altre, cosicché non tutte possono essere simultaneamente soddisfatte e si rendono necessari accomodamenti. Alcuni esempi di sistemi frustrati si trovano nella fisica della materia condensata, ma anche in biologia, nelle scienze computazionali, nei problemi decisionali e di decodificazione e nelle scienze sociali. Una delle caratteristiche chiave di tali sistemi è di possedere molti stati globali metastabili, vale a dire stati dell'intero sistema nei quali una modificazione della condizione di un qualsivoglia individuo porterebbe a un abbassamento della qualità di vita di tutto l'insieme. Uno o più di questi stati del sistema costituirà il migliore compromesso possibile, ma di solito è di difficile determinazione a priori; piuttosto, si è spesso indotti (o la natura lo è) a cercare tale miglior soluzione mediante alcune procedure iterative, in cui l'attraversamento delle barriere presenti tra gli stati metastabili è ostacolato ‒ il che dà luogo a una dinamica estremamente lenta, come accade per i vetri e per molti problemi che in pratica sono di difficile ottimizzazione. D'altro canto, in alcune situazioni, le barriere tra gli stati metastabili possono anche tornare utili, come nel caso della memoria neuronale.

In generale, si chiamano complessi quei sistemi il cui comportamento macroscopico è molto più ricco di quello dei suoi singoli ingredienti microscopici, ed evolve mediante la cooperazione tra questi ultimi. Nello spirito di ricercare proprietà qualitative universali che permettano di tenere distinta la complessità dalla mera complicazione, con tali sistemi si ricorre spesso a modelli minimali, in cui tanto le componenti microscopiche individuali quanto le loro interazioni sono semplici.

Lo studio del comportamento complesso quale conseguenza della combinazione di disordine e frustrazione è nato indipendentemente in diversi ambiti. Il contesto d'origine che qui esamineremo è quello della fisica dello stato solido, i cui sviluppi hanno portato a progressi concettuali, quantitativi e applicativi molto fecondi, attraverso l'apporto combinato di analisi matematica, simulazione numerica ed esperimenti. Il punto di partenza di questa vicenda è apparentemente angusto e oscuro, ma la ricaduta si è rivelata ampia. Nei primi anni Settanta del Novecento, esperimenti su alcune leghe metalliche mostrarono quel che sembrava essere una transizione atipica, da una fase paramagnetica (disordinata) ad alte temperature verso una fase magneticamente congelata a temperature inferiori, non di tipo ferromagnetico normale o antiferromagnetico periodico, ma caratterizzata piuttosto da momenti magnetici congelati in una sorta di ordinamento amorfo, a cui fu dato il nome di vetro di spin. I tentativi di inquadrare tale comportamento all'interno di un modello teorico diedero origine all'elaborazione dei concetti già menzionati e, in seguito, a metodi per quantificarli ed estendere ad altri campi le idee via via formulate.

Un semplice modello minimale, in cui sono presenti le caratteristiche chiave, prevede che i momenti magnetici atomici (spin) assumano due soli stati (convenzionalmente su e giù) e interagiscano a coppie, a volte in maniera ferromagnetica, favorendo un uguale allineamento della coppia di spin ‒ entrambi su o entrambi giù ‒ a volte in maniera antiferromagnetica, favorendo allineamenti opposti, uno spin su e l'altro giù. Se le interazioni sono, a caso, ferromagnetiche o antiferromagnetiche, allora si hanno gli ingredienti per un vetro di spin; cammini di interazione chiusi con un numero dispari di interazioni antiferromagnetiche non possono essere tutti soddisfatti e si ha frustrazione. Inoltre, non vi è periodicità nella natura di questi cicli frustrati. Tale problema può essere quantificato attribuendo un costo cumulativo (l'energia, nel linguaggio della fisica) a tutte le interazioni non soddisfatte. Studi dimostrano che ci sono molti stati metastabili in cui il ribaltamento di ogni singolo spin determina un aumento del costo.

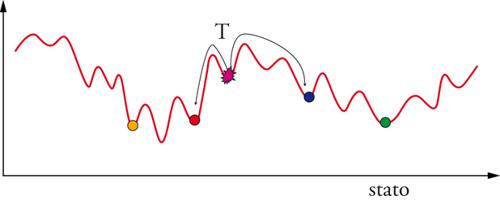

L'energia è una funzione delle configurazioni microscopiche con moltissimi minimi locali. Usando un linguaggio figurativo, possiamo dire che nello spazio (a molte dimensioni) dei possibili stati è presente un paesaggio di energia corrugato, che comprende molte valli, cime e passi: la dinamica dei ribaltamenti degli spin è alla ricerca, in questo paesaggio, dell'equilibrio corrispondente al moto locale (fig. 1). In tale rappresentazione, un sistema a temperatura nulla corrisponde al caso in cui gli unici spostamenti permessi sono verso valle. A temperatura finita sono ammessi anche movimenti ascensionali, con probabilità proporzionale a exp(−ΔE/T), dove ΔE è il costo energetico e T la temperatura assoluta, ma, a meno di non aumentare notevolmente la temperatura ‒ oltre quella critica ‒ è ancora difficile lasciare una regione metastabile per una molto diversa, a causa del concorso di barriere energetiche e cammini intricati.

A temperatura finita, la quantità rilevante per l'equilibrio termodinamico è l'energia libera, che include anche effetti entropici; tuttavia, un paesaggio del tutto simile dal punto di vista concettuale è spesso presente anche se consideriamo la dipendenza da altre quantità macroscopiche in cui interviene l'ordine. Prendendo in esame l'energia libera, il paesaggio diventa meno corrugato all'aumentare della temperatura. Ai fini della termodinamica di equilibrio, gli stati che contano sono quelli con energia libera più bassa; a una certa temperatura critica avviene una transizione verso una fase paramagnetica non ordinata. Anche un modello così semplice prevede, al di sotto di detta temperatura, una struttura gerarchica di stati metastabili assai ricca. Dal punto di vista della dinamica, a una diminuzione della temperatura corrisponde la transizione tra un comportamento di rilassamento veloce e quello lento tipico dei vetri. Nella fase a bassa temperatura si riscontra il fenomeno dell'invecchiamento, in cui è presente una memoria a lungo termine della storia passata del sistema. Dall'analisi di questo modello sono emerse numerose sottili questioni che, se da un lato hanno rappresentato una sfida per i modi di pensare e le metodologie convenzionali, dall'altro una volta risolte hanno arricchito la nostra comprensione e il nostro bagaglio tecnico e hanno stimolato esperimenti e nuove scoperte.

Se tutto fosse risolto così, è probabile che nella fisica dei solidi i vetri di spin sarebbero rimasti una parentesi oscura, per quanto appassionante. In realtà, dato che molti dei concetti e delle tecniche sviluppatisi trovano applicazione in campi assai più ampi, questo semplice modello è diventato un paradigma per uno studio dei sistemi complessi più ampio. Una delle tante applicazioni riguarda i problemi di ottimizzazione in cui sono presenti conflitti che impediscono una facile risoluzione, interessanti sia in molti casi pratici sia come problemi fondamentali nelle scienze computazionali, per esempio per le classificazioni in gradi di difficoltà, per confermare l'esistenza di soluzioni e per inventare algoritmi efficienti. Una questione tipica è quella di trovare la partizione ottimale, rilevante nei molti problemi pratici in cui un processo decisionale (o uno strumento elettronico) deve essere diviso in blocchi di taglia simile, tra i quali il segnale sia trasferito più lentamente che non all'interno dei blocchi stessi, e quindi ottimizzato. Ciò è illustrato dal seguente problema di partizione dei grafi: bisogna separare i vertici di un grafo, connessi casualmente a coppie mediante spigoli, in due gruppi contenenti lo stesso numero di elementi, in modo che il numero di spigoli tra i due gruppi sia minimo (problema del taglio minimale, detto anche mincut). Questo problema può essere messo in rapporto con una variante del semplice vetro di spin discusso prima: l'assegnare un vertice all'uno o all'altro dei due gruppi corrisponde allo stato verso l'alto o verso il basso dello spin, mentre la condizione che il grafo abbia o meno uno spigolo tra due vertici corrisponde alla presenza o assenza casuale di legami di interazione ferromagnetici; la frustrazione è data dal vincolo che i due gruppi devono essere delle stesse dimensioni. Il disordine interviene poiché, come in molti altri problemi di ottimizzazione e come sarà implicitamente assunto nel seguito, non vi è in generale alcuna relazione semplice tra la connettività richiesta dalla rete e la necessità di una separazione semplice. Maxcut è un problema simile, in cui l'obiettivo è trovare una maniera di separare i vertici in due gruppi, avendo il numero massimo di spigoli tra i due gruppi; esso si trasforma in un analogo vetro di spin con legami antiferromagnetici o assenti.

In entrambi i casi si è interessati a grafi casuali (o casuali in modo efficace, dal punto di vista di questi problemi decisionali). Si ha quindi quella combinazione di frustrazione e disordine che fa sì che, nuovamente, la topologia ruvida del paesaggio della funzione costo sia complessa; in questo caso, il costo è l'opposto del numero di spigoli tra le due sezioni. Maxcut e mincut sono evidentemente problemi complessi, noti nelle scienze computazionali come NP-hard (secondo una famosa congettura, il tempo di calcolo per risolvere il più difficile problema NP-hard a N elementi cresce esponenzialmente con N). è chiaro che, quando il numero di vertici diventa grande, non si possono prevedere tutte le possibili soluzioni, in quanto il loro numero aumenta secondo una legge esponenziale con quello dei vertici stessi, né si può utilizzare una procedura semplice di discesa lungo il gradiente del paesaggio efficace, perché quest'ultimo presenta rugosità.

Metodi di ottimizzazione e applicazioni

Tanto i modelli di vetro di spin quanto gli esempi di ottimizzazione sopra menzionati, con interazioni a coppie tra entità binarie, presentano simultaneamente transizioni termodinamiche e dinamiche quando i loro parametri di controllo, come la temperatura, variano attraversando i valori critici. Esiste però un'altra classe di problemi, in cui le transizioni dinamiche non permettono di realizzare le transizioni termodinamiche, qualora si varino i parametri di controllo per passare dallo stato non vetroso a quello vetroso. È quanto si verifica nei modelli di vetri di spin in cui le interazioni fra spin non hanno una simmetria di riflessione semplice e in cui la temperatura è il parametro di controllo naturale. Nelle scienze computazionali ciò è esemplificato dai problemi detti K-SAT, che consistono nel trovare valori di quantità booleane che soddisfino simultaneamente molte clausole di lunghezza K; in questo caso il parametro di controllo è il rapporto tra il numero di clausole e quello di variabili, dove, nel limite di molte clausole, la soddisfazione è possibile se questo rapporto è al di sotto di un certo valore critico.

Di fatto, l'adozione di concetti e tecniche propri dei vetri di spin ha permesso di identificare nel problemaK-SAT due rapporti critici: l'uno riguarda la separazione, analoga a una transizione termodinamica, tra fase in cui le clausole possono essere tutte contemporaneamente soddisfatte (SAT) e fase in cui nessuna configurazione è in grado di soddisfare un numero così elevato di condizioni (UNSAT); l'altro rapporto, più piccolo del primo, è invece l'analogo di una transizione dinamica (o di stabilità marginale) e corrisponde all'emergere, tra SAT e UNSAT, di una regione in cui le clausole possono essere difficilmente soddisfatte. Di particolare interesse è stata l'applicazione di una tecnica sviluppata per lo studio degli stati fondamentali dei vetri di spin sui reticoli diluiti, che ha fornito un nuovo algoritmo per risolvere problemi di soddisfazione.

Una situazione simile di doppia transizione, è importante anche per i codici correttori d'errore. Le informazioni trasmesse in presenza di rumore sono soggette a distorsione. Claude E. Shannon ha dimostrato che, in linea di principio, la decodificazione senza errori è possibile se si introduce un'opportuna ridondanza nei codici trasmessi e ha calcolato la ridondanza minima necessaria. Sebbene il trovare un algoritmo che funzioni in tempi non eccessivamente lunghi, e che raggiunga il limite di Shannon per la ridondanza minima si sia rivelata una meta proibitiva, il controllo di parità (parity-check) a bassa densità fornisce, allo stato attuale, uno degli approcci migliori. Questi codici presentano una somiglianza con i ferromagneti con interazioni a molti spin, che, se opportunamente interpretati, diventano vetri di spin con interazioni a molti spin. La decodifica è un problema di ottimizzazione. I codici basati su interazioni a due spin non raggiungono il limite di Shannon; esistono altresì codici che coinvolgono interazioni di ordine più alto: il limite di Shannon risulta allora l'analogo della transizione termodinamica, mentre l'algoritmo di decodificazione è una dinamica soggetta a una transizione di incollamento (sticking), che avviene prima di aver raggiunto questo limite. Uno degli scopi della ricerca corrente è trovare codici con transizione dinamica la più vicina possibile al limite di Shannon.

Applicazioni come queste avvalorano il metodo in base al quale, a volte, si studia accuratamente un modello semplificato che si allontana, anche notevolmente, dalla realtà, in modo da ottenere problemi che si possano risolvere analiticamente e quindi arrivare a una comprensione profonda delle cause del comportamento del sistema. I veri vetri di spin, in cui vi è interazione solamente tra spin vicini, non sono risolubili analiticamente; lo sono però le loro controparti teoriche, in cui le interazioni hanno una portata infinita e tutti gli spin interagiscono: dalla loro risoluzione sono scaturiti concetti e tecniche nuove. Stabilire in che misura tutto ciò valga anche per i vetri di spin reali dei materiali solidi rimane un punto controverso; tuttavia, molte delle analogie al di fuori della fisica, come quelle sopra riportate, hanno interazioni con portata infinita, e in questo caso la teoria è certamente ben fondata.

Applicazioni biologiche

Un'altra analogia nasce se si prende in considerazione la modellizzazione della memoria neuronale associativa, sia come idealizzazione del cervello ‒ benché le operazioni biologiche reali non siano ancora completamente chiare ‒ sia in quanto strumento artificiale affidabile che apprende dall'esperienza. La fig. 2 illustra il processo di modellizzazione in cui è mostrata una sezione di cervello, dove le gocce triangolari sono i neuroni da cui emergono gli assoni, che a loro volta conducono, attraverso le sinapsi, ad altri neuroni, insieme a rappresentazioni diverse provenienti da vari ambiti disciplinari.

Un'immagine neuronale è caratterizzata da uno stato globale, o configurazione, di tutti i neuroni; un'immagine memorizzata è ben ricostruita se la somiglianza, o sovrapposizione, tra lo stato neuronale globale corrente e quello corrispondente all'immagine memorizzata è elevata, là dove la somiglianza può essere definita come quella frazione di stati individuali dei singoli neuroni che coincidono. La memoria associativa consiste allora nel fatto che il sistema, a partire da inizializzazioni distorte, si muova dinamicamente verso stati che corrispondono a immagini immagazzinate. Il processo, ancora una volta, può essere rappresentato come un flusso attraverso un paesaggio corrugato, nello spazio degli stati neuronali globali in cui i minimi corrispondono a memorie immagazzinate e in cui i bacini di ricordo associativo sono le regioni dalle quali il flusso dinamico muove verso i minimi. Per immagazzinare numerose memorie si richiede che il paesaggio abbia molti minimi, cosa che a sua volta implica frustrazione nelle interazioni sinaptiche. Nel caso in cui le immagini da memorizzare siano effettivamente scorrelate tra loro, entra in gioco il disordine. Più lento è il processo di apprendimento, nel quale le sinapsi sono addestrate a modellare il paesaggio energetico e a collocare in posizione corretta i minimi. Ciò è illustrato nella fig. 3, dove si mostra come in sistemi ipersemplificati può aver luogo il ricordo schizofrenico, in cui l'immagine finale è una combinazione di due immagini differenti: quest'effetto indesiderato è però eliminabile se è presente rumore stocastico, che gioca un ruolo simile a quello della temperatura.

Entriamo un po' più nel dettaglio dell'analogia con i vetri di spin. I neuroni sono in grado di operare a diverse velocità e inviare ad altri neuroni, attraverso le sinapsi, segnali che possono essere eccitatori, nel caso aumentino la tendenza del neurone di arrivo ad attivarsi, oppure inibitori, se la diminuiscono. Questi casi sono equivalenti alle interazioni ferromagnetiche e antiferromagnetiche che provocano frustrazione nei vetri di spin. Nel modello più semplice, il segnale (o potenziale) di entrata per un neurone è la somma delle frequenze di attivazione dei neuroni afferenti, moltiplicate per l'efficienza delle sinapsi che li collegano al neurone. Il segnale di ingresso determina successivamente l'azione efferente del neurone, attraverso una funzione di risposta a forma di sigmoide (una sorta di gradino arrotondato, fig. 4): l'arrotondamento del grafico svolge un ruolo analogo a quello della temperatura nelle figure mostrate prima.

Disordine autoindotto

Nei sistemi esaminati finora, il disordine congelato è presente nella forma degli ingredienti microscopici o delle regole di interazione. In presenza di un rilassamento vetroso, tuttavia, si può ottenere disordine autoindotto anche con ingredienti microscopici e regole puramente omogenei: è ciò che si ritiene che accada con i vetri strutturali (quelli delle finestre), benché in pratica per prevenire la cristallizzazione essi debbano essere spesso costituiti da miscele. Tali sistemi sono stati modellizzati in vari modi: per quanto riguarda i vetri covalenti, li si descrive come reticoli casuali di vertici dotati di legami secondo direzioni preferenziali o anche in termini di atomi che interagiscono mediante forze centrali soggette a disturbi od ostacolate da gabbie (come in un ingorgo stradale), oppure, con un'immagine ancora più metaforica, come sistemi muniti di trappole o sottoposti a dinamiche vincolate.

è interessante notare che progressi significativi nella comprensione e modellizzazione dei cosiddetti vetri fragili sono stati resi possibili dalle analogie che questi ultimi presentano con alcune caratteristiche rilevate, per la prima volta, in modelli artificiali di vetri di spin, in cui agiscono interazioni di portata infinita, a molti spin o tra spin di tipo non ordinario. Si tratta di caratteristiche che sono state ravvisate dapprima attraverso l'analisi formale, ma la cui generalizzazione va ascritta a un'appropriata rappresentazione concettuale delle loro cause fisiche. È stato così possibile comprendere il concetto di invecchiamento nei vetri, in base al quale il comportamento di un sistema dipende da quanto tempo esso è rimasto alla temperatura considerata, secondo una legge di scala che deriva dal rapporto tra il tempo che segue e quello che precede l'inizio delle misurazioni; è stato chiarito che un vetro non all'equilibrio può apparire come un sistema a temperatura più alta rispetto a quella ambiente ed è stata individuata, e spiegata, l'esistenza di diverse temperature caratteristiche alle quali avvengono cambiamenti di regime.

Vi sono anche molti altri problemi in cui il disordine è autoindotto, per esempio quelli di deposizione casuale o di erosione delle valli da parte dei fiumi. Ciò conduce ad altre questioni, quali le effettive dimensioni frattali di volumi, superfici o contorni risultanti; per esempio, la lunghezza delle coste di un'isola o di una regione peninsulare (come la Gran Bretagna o l'Italia) sarà differente a seconda della lunghezza dell'asta usata nelle misurazioni. Molti problemi simili coinvolgono la criticità autoorganizzata, in cui i sistemi evolvono naturalmente, secondo la loro dinamica, verso situazioni nelle quali valgono leggi di scala autosimili analoghe a quelle di una normale transizione di fase termodinamica, ma senza che per questo si renda necessario regolare un parametro di controllo esterno. Un classico esempio è la sabbia, che fatta cadere asciutta forma un mucchio che raggiunge in maniera naturale un particolare angolo di pendenza.

Le polveri sono sistemi disordinati che presentano caratteristiche ancora più stimolanti. Possono fluire come liquidi e bloccarsi come se fossero vetri. Nel caso specifico, la temperatura è essenzialmente irrilevante e il suo ruolo è svolto dalla compattezza, quantità legata alla derivata dell'entropia configurazionale rispetto al volume. Al momento attuale non è chiaro in che misura concetti e relazioni di natura termodinamica si possano applicare a questi sistemi, pur essendoci collegamenti molto stretti. Un altro gruppo di sistemi disordinati per i quali l'entropia assume maggiore importanza rispetto all'energia è quello dei polimeri fusi e solidi; per esempio, è di origine prevalentemente entropica l'elasticità della gomma. L'entropia fa contrarre i polimeri, come se fossero spaghetti disordinati; la loro incapacità di attraversarsi a vicenda ostacola il moto del singolo polimero, che compie un movimento detto di reptazione (reptation) attraverso cunicoli formati dagli altri polimeri. Nel momento in cui si effettua la vulcanizzazione, sono stabiliti legami tra i polimeri nei punti in cui questi ultimi si incrociano: tali legami incrociati e tutte le conseguenti restrizioni topologiche agiranno come vincoli sulla dinamica e sulla termodinamica dei polimeri.

Bibliografia

Amit 1989: Amit, Daniel J., Modeling brain function, Cambridge, Cambridge University Press, 1989.

Anderson 1958: Anderson, Philip W., Absence of diffusion in certain random lattices, "Physical review", 109, 1958, pp. 1492-1501.

Anderson 1988-1990: Anderson, Philip W., Spin-glassI-VII, "Physics today", 41/1, 1988, pp. 9-11; 41/3, 1988, p. 9; 41/6, 1988, pp. 9-11; 41/9, 1988, pp. 9-11; 42/7, 1989, pp. 9-11; 42/9, 1989, pp. 9-11; 43/3, 1990, pp. 9-11.

Bak, Sneppen 1993: Bak, Per - Sneppen, Kim, Punctuated equilibrium and criticality in a simple model of evolution, "Physical review letters", 71, 1993, pp. 4083-4086.

Garey, Johnson 1979: Garey, Michael R. - Johnson, David S., Computers and intractability. A guide to the theory of NP-completeness, New York, Freeman, 1979.

Mandelbrot 1975: Mandelbrot, Benoît, Les objects fractals: forme, hasard et dimension, Paris, Flammarion, 1975.

Mandelbrot 1982: Mandelbrot, Benoît, The fractal geometry of nature, San Francisco, Freeman, 1982.

Martin 2001: Martin, Olivier C. - Monasson, Rémi - Zecchina, Riccardo, Statistical mechanics methods and phase transitions in optimization problems, "Theoretical computer science", 265, 2001, pp. 3-67.

Mézard 1986: Mézard, Marc - Parisi, Giorgio - Virasoro, Miguelangel, Spin-glass theory and beyond, Singapore, World Scientific, 1986.

Sherrington, Kirkpatrick 1975: Sherrington, David - Kirkpatrick, Scott, Solvable model of a spin-glass, "Physical review letters", 35, 1975, pp. 1792-1796.

Sourlas 1989: Sourlas, Nicolas, Spin-glass models as error-correcting codes, "Nature", 339, 1989, pp. 693-694.

Stauffer, Aharony 1994: Stauffer, Dietrich - Aharony, Amnon, Introduction to percolation theory, 2. ed., London, Taylor & Francis, 1994 (1. ed.: 1985).